Was ist programmatisches SEO?

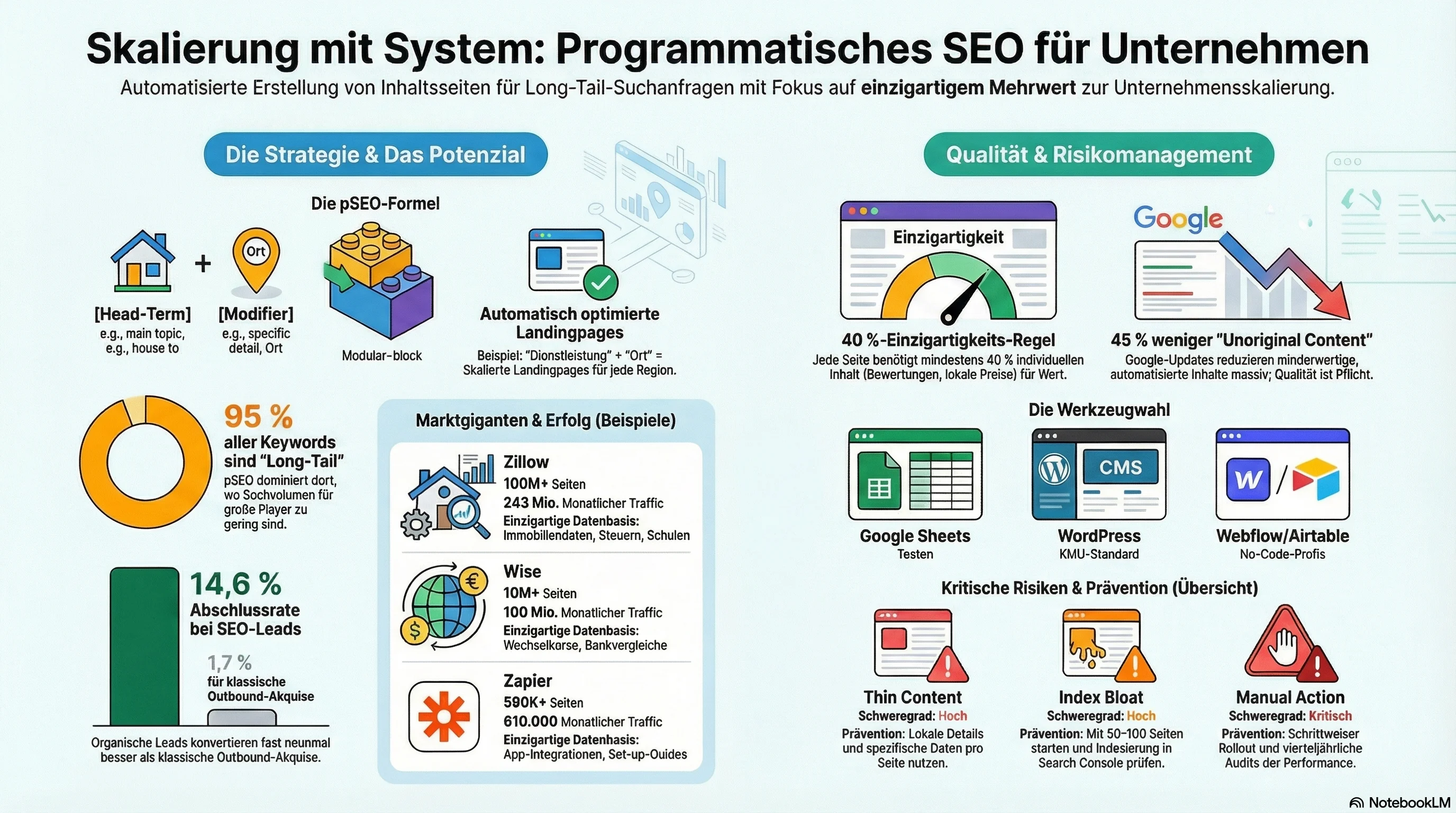

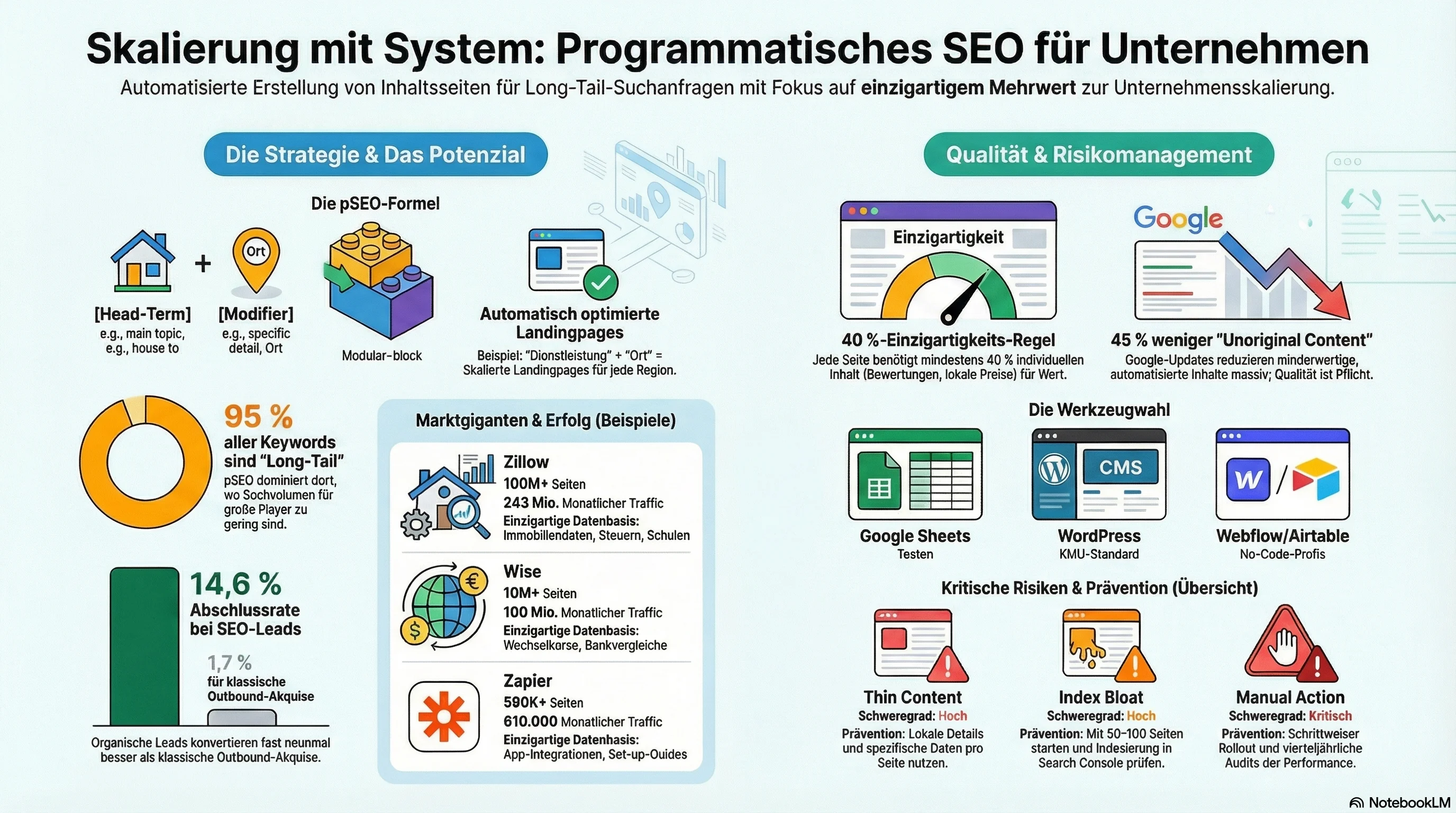

Der Template-und-Daten-Ansatz, der es einer einzelnen Person ermöglicht, Hunderte suchoptimierter Seiten zu erstellen

Stellen Sie sich vor, Sie sind ein Klempner, der 30 Städte in Ihrer Metropolregion bedient. Sie bieten 5 Kernleistungen an — Abflussreinigung, Warmwasserspeicher-Reparatur, Rohrersatz, Leckortung unter der Bodenplatte und Notfalleinsätze. Das ergibt 150 potenzielle Seiten: „Abflussreinigung in Frankfurt", „Warmwasserspeicher-Reparatur in Offenbach" und so weiter.

150 einzigartige Seiten von Hand schreiben? Das sind Monate an Arbeit. Aber was wäre, wenn Sie ein Seitentemplate erstellen, es mit einer Tabelle Ihrer Städte und Dienstleistungen verbinden und alle 150 Seiten automatisch generieren könnten — jede mit einzigartigen lokalen Details?

Das ist programmatisches SEO. Es ist die systematische Erstellung großer Mengen suchoptimierter Seiten mithilfe von Automatisierung, Templates und strukturierten Daten, um Hunderte oder Tausende verwandter Suchanfragen abzudecken [1].

Die Formel ist einfach: Hauptbegriff + Modifikator = Seite. „Hotels in" + „[Stadt]" = eine Seite pro Stadt. „[App A]" + „[App B] Integration" = eine Seite pro Integrationspaar. „[Dienstleistung]" + „in [Stadtteil]" = eine Seite pro Standort.

So funktioniert der Prozess in der Praxis:

Keyword-Muster identifizieren

Finden Sie eine wiederkehrende Formel aus „Hauptbegriff + Modifikator", die echtem Suchverhalten entspricht

Eine strukturierte Datenbank aufbauen

Sammeln Sie Daten über Tabellen, APIs oder manuelle Recherche — das ist Ihre Inhaltsquelle

Ein Seitentemplate entwerfen

Erstellen Sie ein wiederverwendbares Layout mit dynamischen Blöcken für Titel, Fließtext und Handlungsaufforderungen

Im großen Maßstab befüllen

Die Automatisierung füllt das Template mit Daten für jede Keyword-Variation

Veröffentlichen, verlinken und pflegen

Seiten mit interner Verlinkung, Sitemaps und Schema-Markup bereitstellen — dann überwachen

Warum das für kleine Unternehmen wichtig ist

Fast 95 % aller Keywords erhalten 10 oder weniger monatliche Suchanfragen [2]. Genau dort entfaltet programmatisches SEO seine Stärke — indem es viele niedrigvolumige Keywords mit wenig Wettbewerb bündelt, die großen Unternehmen zu unbedeutend erscheinen. SEO-Leads schließen mit 14,6 % ab, verglichen mit 1,7 % bei Outbound [13] — selbst Seiten mit wenig Traffic können echtes Geschäft generieren, wenn die Kaufabsicht stimmt.

Der entscheidende Unterschied: Programmatisches SEO bedeutet nicht, minderwertige Seiten in Masse zu produzieren. Es geht darum, nützliche Seiten in Masse zu erstellen — wobei jede einzelne eine spezifische Frage mit Daten beantwortet, die dem Leser tatsächlich helfen. Die Unternehmen, die das richtig machen, sehen außergewöhnliche Ergebnisse. Die, die es nicht schaffen, werden abgestraft. Wir behandeln beides.

Wer macht es bereits? (Praxisbeispiele)

Von 2.000 Seiten bis 100 Millionen — Unternehmen, die Imperien auf programmatischem SEO aufgebaut haben

Bevor Sie entscheiden, ob programmatisches SEO für Ihr Unternehmen sinnvoll ist, schauen Sie sich an, wer es bereits macht — und wie viel Traffic dabei generiert wird:

Monatlicher organischer Traffic aus programmatischen Seiten

Daten von Backlinko, Gupta Deepak, Kensaku AI — beachten Sie den logarithmischen Skalenunterschied

Die Unterschiede in der Größenordnung sind atemberaubend. Zillow generiert 243 Millionen organische Besuche pro Monat durch programmatische Seiten zu Immobilienwerten, Verkäufen, Mietangeboten und Schulbezirken [2]. Jede Immobilienseite ist mit einem einzigartigen Datensatz verbunden — MLS-Einträge, Steuerunterlagen, historische Preisentwicklung, Walkability-Scores. Das ist kein dünner Content — das ist eine Datenbank genutzter Informationen, dargestellt als Webseiten.

Wise (das Geldtransfer-Unternehmen) hat über 10 Millionen programmatische Seiten — allein 8,5 Millionen Währungsumrechner-Seiten, verteilt auf 170 Sitemaps [2]. Jede Seite enthält Echtzeit-Wechselkurse, interaktive Rechner, historische Charts und Bankvergleiche. Dazu generieren sie Seiten für SWIFT-Codes (1,25 Mio. Seiten), Aktienticker (280.000+) und IBAN-Abfragen (~10.000).

Zapier hat 590.000+ Seiten allein im /apps/-Unterordner, die 610.000+ organische Besuche pro Monat generieren — nur aus diesem Bereich [5]. Ihre Integrationsseiten enthalten Schritt-für-Schritt-Anleitungen, Anwendungsfälle, Vorlagen, Fehlerbehebung und Nutzerbewertungen. Durchschnittliche Verweildauer: 2 Minuten 47 Sekunden. Absprungrate: nur 34 % [8].

Zillow

100 Mio.+ Seiten243 Mio. Besuche/Mo. — MLS-Einträge, Steuerunterlagen, Schulbewertungen, Walkability-Scores

Wise

10 Mio.+ Seiten100 Mio.+ Besuche/Mo. — Echtzeit-Wechselkurse, Rechner, historische Charts, Bankvergleiche

Zapier

590.000+ Seiten610.000 Besuche/Mo. (nur Apps) — Schritt-für-Schritt-Anleitungen, Anwendungsfälle, Vorlagen, Nutzerbewertungen, Update-Logs

TripAdvisor

Millionen Seiten226 Mio. Besuche/Mo. — Nutzerbewertungen, Buchungsoptionen, Fotos, Bewertungen pro Attraktion

Nomadlist

2.000+ Seiten50.000 Besuche/Mo. — Internetgeschwindigkeiten, Lebenshaltungskosten, Wetter, Visa-Infos, Sicherheits-Scores

Was die Gewinner gemeinsam haben

Jede erfolgreiche programmatische SEO-Seite oben hat eines gemeinsam: einzigartige Daten pro Seite. Zillow hat Immobiliendaten. Wise hat Live-Wechselkurse. Zapier hat integrationsspezifische Anleitungen. Nomadlist hat Echtzeit-Stadtmetriken. Das Template ist dasselbe — aber die Daten, die es füllen, sind auf jeder einzelnen Seite tatsächlich unterschiedlich und nützlich. Nehmen Sie die einzigartigen Daten weg, und es bleibt Spam übrig.

Yelp und TripAdvisor verfolgen einen anderen Ansatz — sie nutzen nutzergenerierte Inhalte als einzigartige Datenschicht. Jede Restaurantseite auf Yelp hat unterschiedliche Bewertungen, Fotos, Öffnungszeiten und Ratings, weil echte Nutzer sie beitragen [1]. TripAdvisor rankt für fast 100.000 Keywords mit „Aktivitäten in" [2], und jede Stadtseite wird mit ortsspezifischen Attraktionen, Reisebewertungen und Buchungsoptionen gefüllt.

Die Erkenntnis lautet nicht „Erstellen Sie 10 Millionen Seiten". Sondern: „Erstellen Sie Seiten, bei denen jede einzelne etwas Einzigartiges und Nützliches enthält, das ihre Existenz rechtfertigt."

Anwendungen für kleine Unternehmen

Sie brauchen keine Millionen von Seiten — schon 50 gut erstellte programmatische Seiten können ein lokales Unternehmen transformieren

Sie sind nicht Zillow. Sie brauchen keine 100 Millionen Seiten. Aber dieselben Prinzipien funktionieren auch in viel kleinerem Maßstab. Hier sind vier Muster, die für echte kleine Unternehmen funktionieren:

Standort + Service-Seiten

Formel: [Dienstleistung] in [Stadt/Stadtteil] · Typischer Umfang: 50–500 Seiten

Ein Klempner mit 30 Städten × 5 Dienstleistungen = 150 Seiten

Vergleichsseiten

Formel: [Ihre Dienstleistung] vs. [Alternative] · Typischer Umfang: 20–100 Seiten

"Invisalign vs. Zahnspange Kosten für Erwachsene" — Zahnarzt, der kaufbereite Anfragen anspricht

FAQ-Seiten im großen Maßstab

Formel: [Frage] über [Dienstleistung] in [Ort] · Typischer Umfang: 100–1.000 Seiten

"Wie viel kostet eine Dachsanierung in München?" mit lokalen Preisdaten

Produktkategorie-Seiten

Formel: [Produkttyp] + [Eigenschaft/Anwendungsfall] · Typischer Umfang: 200–5.000 Seiten

"Wasserdichte Laufschuhe für Trailrunning unter 100 €"

Standort- und Service-Seiten sind der Klassiker für kleine Unternehmen. Ein Zahnarzt mit drei Praxen und acht Leistungen könnte 24 einzigartige Seiten erstellen — „Zahnaufhellung in München-Schwabing", „Zahnarzt-Notdienst in Bogenhausen", „Invisalign-Beratung in Sendling". Jede Seite zielt auf eine spezifische lokale Suchanfrage ab, die Menschen tatsächlich stellen, wenn sie einen Zahnarzt brauchen [9].

Ein Immobilienmakler könnte dasselbe mit Stadtteilen machen: „Wohnungen zum Verkauf in [Stadtteil]", „Lebenshaltungskosten in [Stadtteil]", „Schulbewertungen und Familienleitfaden für [Stadtteil]". Jede Seite zieht echte Daten heran — aktuelle Angebote, Durchschnittspreise, Schulnoten, Pendelzeiten — die sie wirklich nützlich machen, nicht nur einen Stadtnamenwechsel [10].

Die Doorway-Page-Falle

Google warnt ausdrücklich davor: 5.000 Seiten für „Klempner in [Stadt]", die alle auf ein einziges Kontaktformular ohne einzigartigen Inhalt pro Standort weiterleiten, sind klassische „Doorway Pages" — und werden abgestraft [8]. Die Lösung? Jede Standortseite muss wirklich unterschiedlichen Inhalt enthalten: lokale Kundenbewertungen, stadtspezifische Vorschriften, Verweise auf die Nachbarschaft, Fotos von tatsächlichen Arbeiten in der Gegend und ortsspezifische Preise.

Vergleichsseiten funktionieren besonders gut für Freiberufler und Dienstleister. Ein Finanzberater könnte „[Investment A] vs. [Investment B] für Rentner"-Seiten erstellen. Eine Anwaltskanzlei könnte „[Rechtsgebiet] Anwalt vs. [DIY-Lösung]"-Seiten aufbauen — „brauche ich einen Anwalt für ein einfaches Testament oder reicht ein Online-Dienst?". Diese zielen auf Suchanfragen mit kommerzieller Absicht ab, bei denen Menschen aktiv ihre Optionen abwägen.

FAQ-Seiten im großen Maßstab sind ein weiterer natürlicher Ansatz. Ein Dachdecker könnte Seiten erstellen für „Wie viel kostet ein [Dachtyp] in [Stadt]?" mit tatsächlichen lokalen Preisdaten, Materialverfügbarkeit und saisonalen Besonderheiten. Ein Zahnarzt könnte „Übernimmt die Versicherung [Behandlung]?"-Seiten aufbauen mit spezifischen Informationen pro Versicherungsanbieter.

Tools & Plattformen

Von kostenlosen Tabellen bis zu vollständigen No-Code-Stacks — wählen Sie den Ansatz, der zu Ihrem technischen Komfort passt

Sie müssen kein Entwickler sein, um programmatisches SEO umzusetzen. Hier ein Vergleich der vier wichtigsten Ansätze, sortiert von einfach bis komplex:

Vergleich programmatischer SEO-Tools

Technische Schwierigkeit vs. Flexibilität — wählen Sie Ihr Komfortniveau

Technische Schwierigkeit: Mittel

Nicht-technische Gründer, die volle Kontrolle ohne Code wollen

Technische Schwierigkeit: Niedrig–Mittel

Unternehmen, die bereits WordPress nutzen und Seiten skalieren wollen

Technische Schwierigkeit: Niedrig

Programmatisches SEO mit minimalem Investment testen

Technische Schwierigkeit: Hoch

Entwicklerteams, die maximale Flexibilität und eigene Frontends wollen

Der Google-Sheets-Ansatz ist der einfachste Einstieg. Tragen Sie Ihre Daten in eine Tabelle ein — Städte, Dienstleistungen, Preise, einzigartige Details — und verbinden Sie sie über eine API oder ein Sync-Tool wie Whalesync mit Ihrem CMS. Es ist kostenlos, Sie wissen bereits, wie es funktioniert, und es zwingt Sie dazu, über Ihre Daten nachzudenken, bevor Sie an Seiten denken [12].

WordPress + WP All Import ist der natürliche nächste Schritt, wenn Sie bereits WordPress nutzen. WP All Import nimmt CSV- oder XML-Daten und erstellt Seiten nach einem Template. Sie entwerfen die Seite einmal, ordnen Ihre Tabellenspalten den Inhaltsfeldern zu und lassen es Seiten generieren. Nicht glamourös, aber es funktioniert — und wenn Sie bereits für WordPress-Hosting zahlen, sind die zusätzlichen Kosten minimal.

Webflow + Airtable + Whalesync ist der beliebte No-Code-Stack. Airtable dient als Datenbank, Webflow liefert Template und CMS, und Whalesync hält alles synchron — bearbeiten Sie in Airtable, sehen Sie die Änderungen automatisch in Webflow. Unternehmen wie Descript und Clay nutzen genau diesen Stack. Er wird von Y Combinator unterstützt und bietet auch Zwei-Wege-Sync mit WordPress, Shopify und Bubble [12].

🟢 Nur die Idee testen? → Google Sheets + Ihr bestehendes CMS

Niedrigste Kosten, geringstes Risiko. Beweisen Sie das Konzept, bevor Sie in Tools investieren.

🟡 Bereits auf WordPress? → WP All Import

Vermeiden Sie den Migrationsstress. Funktioniert mit dem, was Sie haben.

🟠 Von Grund auf neu, nicht-technisch? → Webflow + Airtable + Whalesync

Ausgereifteste No-Code-Option. Visueller Editor, Zwei-Wege-Sync, guter Community-Support.

🔴 Entwicklerteam, maximale Flexibilität? → Headless CMS (Contentful/Strapi)

Volle Kontrolle, API-first, beliebiges Frontend. Für die meisten kleinen Unternehmen überdimensioniert.

Für die meisten kleinen Unternehmen lautet die ehrliche Empfehlung: Beginnen Sie mit einer Tabelle und Ihrer bestehenden Website-Plattform. Bringen Sie 20–50 Seiten online, beobachten Sie deren Performance, und investieren Sie erst in aufwändigere Tools, wenn die Ergebnisse es rechtfertigen.

Der Google-Realitätscheck

Googles John Mueller nannte programmatisches SEO ein 'schickes Banner für Spam'. Was das für Sie bedeutet.

Lassen Sie uns hier direkt sein: Google ist kein Freund von programmatischem SEO, so wie die meisten es praktizieren. Die Haltung ist zunehmend strenger geworden, und wenn Sie diese Strategie nutzen wollen, müssen Sie die Regeln verstehen — nicht die optimistische Version, die SEO-Blogs verkaufen, sondern die tatsächlichen Regeln.

Googles John Mueller formulierte es unverblümt: „Programmatisches SEO ist oft ein schickes Banner für Spam" [3]. Das ist ein leitender Google-Search-Relations-Mitarbeiter, der Ihnen direkt sagt, dass das Etikett massenproduzierte Inhalte nicht weniger spamhaft macht.

Im März 2024 führte Google sein bislang einschneidendstes Update durch — ein kombiniertes Core-Update und Spam-Richtlinien-Überarbeitung, das 45 Tage für die Ausrollung brauchte (der längste Rollout aller Zeiten) [7]. Das Update führte speziell eine Richtlinie gegen skalierten Content-Missbrauch ein:

Auswirkungen des Google-Updates vom März 2024

Wie das Update programmatische und skalierte Inhalte betraf

Quelle: Conbase / Search Engine Journal

Quelle: Google Search Central

Quelle: Gupta Deepak

Quelle: AirOps

Das Ergebnis: eine 45%ige Reduktion unorigineller Inhalte in den Suchergebnissen — das ursprüngliche 40%-Ziel wurde sogar übertroffen [11]. Websites, die auf massenproduzierte Landingpages setzten, erlebten die stärksten Einbrüche. Eine Website verlor 94 % ihres Traffics über Nacht, nachdem sie 3.000 dünne programmatische Seiten veröffentlicht hatte [8].

Hier der genaue Wortlaut aus Googles Richtlinie: „Skalierter Content-Missbrauch liegt vor, wenn viele Seiten mit dem primären Zweck der Manipulation von Suchrankings und nicht zur Unterstützung der Nutzer erstellt werden" [7]. Die entscheidende Nuance: Google ist es egal, ob Inhalte von Menschen, KI oder Automatisierung erstellt wurden. Was zählt, ist, ob sie Menschen helfen.

E-E-A-T gilt für jede Seite

Googles Richtlinien für hilfreiche Inhalte fragen gezielt: „Wurde der Inhalt primär erstellt, um Besucher aus Suchmaschinen anzuziehen?" und „Verwenden Sie umfangreiche Automatisierung zur Produktion von Inhalten zu vielen Themen?" Wenn die ehrliche Antwort auf beides ja lautet, befinden Sie sich in der Gefahrenzone. Programmatisches SEO funktioniert nur, wenn jede Seite durch einzigartige, substanzielle Daten echte Erfahrung, Expertise, Autorität und Vertrauenswürdigkeit demonstriert [3].

Das Helpful-Content-System ist jetzt vollständig in Googles Core-Ranking-Algorithmus integriert — es läuft kontinuierlich, nicht als periodische Updates [7]. Und die neue Richtlinie gegen skalierten Content-Missbrauch gilt unabhängig davon, wie der Inhalt erstellt wurde: „egal ob von Menschen geschrieben, durch automatisierte Tools oder hybrid" [7].

Das bedeutet nicht, dass programmatisches SEO tot ist. Zillow, Zapier, Wise und TripAdvisor florieren weiterhin. Aber sie haben Erfolg, weil ihre Seiten echten Mehrwert bieten — nicht weil sie eine Lücke gefunden haben. Die Messlatte ist gestiegen, und wenn Ihre programmatischen Seiten sie nicht überspringen, werden sie nicht nur nicht ranken — sie könnten Ihre gesamte Domain herunterziehen.

Risiken & wie man sie vermeidet

Die fünf Fehlerquellen beim programmatischen SEO — und die konkreten Schritte, um jede zu verhindern

Die meisten programmatischen SEO-Projekte scheitern. Nicht weil das Konzept fehlerhaft ist, sondern weil bei der Umsetzung Abkürzungen genommen werden. Hier sind die fünf Fehlerquellen und was Sie bei jeder dagegen tun können:

Dünner Content

highSeiten, die lediglich eine Stadt oder ein Keyword gegen ein anderes austauschen — mit 85 %+ identischem Inhalt.

Prävention: Jede Seite braucht mindestens 40 % einzigartige Daten — lokale Bewertungen, spezifische Preise, ortsbezogene Details.

Index-Aufblähung

highMehr Seiten zu veröffentlichen, als die Domain-Autorität tragen kann, verschwendet Crawl-Budget.

Prävention: Beginnen Sie mit 50–100 Seiten. Überwachen Sie die Indexierungsrate in der Search Console, bevor Sie skalieren.

Duplicate Content

mediumNahezu identische URLs signalisieren niedrige Qualität und lösen Deduplizierungsfilter aus.

Prävention: Verwenden Sie Canonical-Tags, sorgen Sie für einzigartige Titel/Metas und differenzieren Sie den Seiteninhalt pro Seite.

Manuelle Maßnahme / Abstrafung

criticalGoogle kann Ihre gesamte Domain markieren und ALLE Inhalte herunterziehen — nicht nur die programmatischen Seiten.

Prävention: Schrittweiser Rollout, vierteljährliche Audits und sofortige Entfernung leistungsschwacher Seiten.

Crawl-Budget-Verschwendung

mediumGooglebot verschwendet Zeit mit minderwertigen Seiten, statt Ihre besten Inhalte zu indexieren.

Prävention: Nutzen Sie robots.txt und noindex für dünne Seiten. Halten Sie die Sitemap sauber — nur wertvolle URLs aufnehmen.

Der 85%-Test

Hier ist der einfachste Test, ob Ihre programmatischen Seiten bestehen werden: Nehmen Sie zwei beliebige Seiten aus Ihrem Template und vergleichen Sie sie. Wenn der Austausch eines Modifikators gegen einen anderen die Seite zu 85 %+ identisch macht, bestehen Sie nicht [8]. „Klempner in Berlin" und „Klempner in Hamburg" dürfen nicht nur den Stadtnamen tauschen — sie brauchen unterschiedliche Bewertungen, unterschiedliche lokale Details, unterschiedliche Preise, unterschiedliche Fotos. Das Template ist dasselbe; die Daten müssen verschieden sein.

Außerdem gibt es den „Boom-and-Bust"-Zyklus, auf den man achten sollte. ZoomInfo wird als klassisches Beispiel angeführt: anfänglicher Traffic-Anstieg durch programmatische Seiten, gefolgt von algorithmischer Abstrafung, gefolgt davon, dass Google sich weigerte, auch nur deren handgeschriebene Inhalte zu ranken [3]. Das Muster ist deprimierend häufig — schnelles Wachstum, Google bemerkt es, plötzlicher Zusammenbruch. Und wenn Ihre Domain erst einmal markiert ist, kann die Erholung über ein Jahr dauern.

Ein Audit ergab, dass ein Kunde fast 8 Millionen von Google entdeckte Seiten hatte, aber nur 650.000 tatsächlich gecrawlt wurden — das heißt, Google lehnte 92 % der Seiten ab, bevor es sie überhaupt anschaute [3]. Diese Millionen ignorierter Seiten waren nicht nur nutzlos — sie verschwendeten aktiv Crawl-Budget, das für die guten Inhalte der Website hätte verwendet werden sollen.

Die ehrliche Wahrheit: Wenn Sie nicht auf jeder programmatischen Seite wirklich einzigartige, nützliche Daten bereitstellen können, erstellen Sie die Seite nicht. Fünfzig starke Seiten übertreffen 5.000 dünne — jedes Mal.

Der Leitfaden: So machen Sie es richtig

Ein Schritt-für-Schritt-Framework für programmatische Seiten, die Google belohnt statt abstraft

Wenn Sie bis hierher gelesen haben, verstehen Sie sowohl die Chance als auch das Risiko. So bauen Sie programmatisches SEO auf, das tatsächlich funktioniert — angefangen beim Qualitäts-Framework, das Gewinner von Verlierern trennt.

Das Wert-Schwellenwert-Framework stammt vom pSEO-Forscher Deepak Gupta, und jede von Ihnen erstellte Seite sollte alle drei Tests bestehen [8]:

Einzigartige-Antwort-Test

"Würde jemand von dieser Seite eine wesentlich andere Antwort erhalten als von Ihren anderen Seiten?"

Schwellenwert: Wenn Sie einen Modifikator gegen einen anderen austauschen und die Seite zu 85 %+ identisch ist, bestehen Sie nicht.

Datensubstanziierungs-Test

"Enthält diese Seite einzigartige Daten, deren Beschaffung Aufwand erforderte?"

Schwellenwert: Mindestens 40 % des Seiteninhalts muss aus einzigartigen Datenquellen stammen.

Engagement-Nachhaltigkeit-Test

"Würden Nutzer bleiben, interagieren und möglicherweise auf diese Seite zurückkehren?"

Schwellenwert: Die Engagement-Metriken sollten innerhalb von 30 % Ihrer handgefertigten Inhalte liegen.

Ein praktischer Denkanstoß: „Würde jemand diese Seite als Lesezeichen speichern oder teilen?" [8] Wenn die Antwort nein ist, sollte die Seite nicht existieren.

Jetzt zu den Umsetzungsschritten:

Beginnen Sie mit Ihrem Datenvorteil

Welche einzigartigen Daten hat Ihr Unternehmen, die die Konkurrenz nicht hat? Lokale Preise, Kundenbewertungen, branchenspezifische Details, Gebietsexpertise. Bauen Sie Seiten auf IHREN Daten auf.

Erstellen Sie das Template richtig

Entwerfen Sie ein Template mit 5+ dynamischen Inhaltsblöcken. Jede Seite sollte für sich vollständig und nützlich aussehen — nicht wie ein Lückentext, bei dem nur die Felder ausgefüllt wurden.

Schrittweiser Rollout (erst 50 Seiten)

Veröffentlichen Sie nicht über Nacht 5.000 Seiten. Beginnen Sie mit 50, messen Sie Indexierung und Engagement über 4–6 Wochen, und skalieren Sie erst, wenn die Metriken gesund aussehen.

Interne Verlinkung einrichten

Jede programmatische Seite verlinkt auf verwandte Seiten und Hub-Seiten. Hub-Seiten verlinken auf alle Unterseiten. Keine verwaisten Seiten — alles innerhalb von 3 Klicks erreichbar.

Schema-Markup hinzufügen

LocalBusiness-, Product-, FAQ- oder BreadcrumbList-Schema auf jeder Seite. Hilft Suchmaschinen, Ihren Inhalt zu verstehen, und kann Rich Snippets auslösen.

Vierteljährliches Audit & Bereinigung

Prüfen Sie alle 3 Monate die Search Console auf Seiten ohne Klicks. Entweder mit mehr einzigartigen Daten anreichern oder noindex setzen/entfernen. Weniger starke Seiten > viele schwache.

Der einfache Lackmustest

Bevor Sie eine Charge programmatischer Seiten veröffentlichen, wählen Sie drei zufällig aus und lesen Sie sie, als wären Sie die Person, die genau nach dieser Anfrage sucht. Finden Sie die Seite hilfreich? Vertrauen Sie ihr? Würden Sie länger als 10 Sekunden darauf bleiben? Wenn Ihre ehrliche Antwort nein ist, gehen Sie zurück zu Schritt 2 und fügen Sie mehr einzigartige Daten hinzu. Die Rechnung geht nur auf, wenn die Seiten gut sind.

Schema-Markup verdient besondere Aufmerksamkeit. LocalBusiness-Schema für Einzugsgebiet-Seiten, Product-Schema für Kategorieseiten, FAQ-Schema für fragenbasierte Inhalte und BreadcrumbList-Schema für die Navigationshierarchie [4]. Schema verbessert nicht direkt das Ranking, hilft aber Suchmaschinen, Ihren Inhalt zu verstehen — und kann Rich Snippets auslösen, die die Klickrate dramatisch verbessern.

Interne Verlinkung ist ebenso wichtig. Bauen Sie eine Hub-and-Spoke-Architektur auf: Ihre Haupt-Service-Seite verlinkt auf alle Standortvarianten, und jede Standortseite verlinkt zurück zum Hub und zu verwandten Standorten. Keine verwaisten Seiten — alles innerhalb von 3 Klicks erreichbar [4]. Nutzen Sie Breadcrumbs für die hierarchische Navigation. Das ist nicht nur für SEO — es macht Ihre Website tatsächlich benutzerfreundlicher.

Und vergessen Sie das vierteljährliche Audit nicht. Überprüfen Sie alle drei Monate in der Google Search Console, welche programmatischen Seiten null Klicks haben. Entweder mit mehr einzigartigen Daten anreichern oder entfernen. Das Beschneiden schwacher Seiten stärkt Ihre starken Seiten — Google verteilt mehr Crawl-Budget und Ranking-Signale an Inhalte, die tatsächlich performen.

Programmatisches SEO ist keine Abkürzung — es ist ein System. Bauen Sie es richtig auf, und Sie haben eine skalierbare Content-Maschine, die Ihren Traffic über Jahre steigert. Bauen Sie es falsch auf, und Sie werfen Ihre gesamte SEO um Monate zurück. Der Unterschied kommt auf eine Frage an: Hilft jede Seite tatsächlich der Person, die darauf landet?

Wenn Sie bereit sind, suchoptimierte Inhalte im großen Maßstab zu erstellen — ob durch programmatische Seiten, regelmäßiges Bloggen oder beides — News Factory wurde entwickelt, um kleinen Unternehmen dabei zu helfen, konsistent qualitativ hochwertige Inhalte zu produzieren, mit KI-Unterstützung, die das menschliche redaktionelle Urteil beibehält. Denn die beste SEO-Strategie ist die, die Sie tatsächlich durchhalten können.

Quellen & Referenzen

In diesem Artikel zitierte Primärquellen

- Semrush — Leitfaden für programmatisches SEO

semrush.com/blog/programmatic-seo/

Wichtige Daten: Template-basierter Seitenerstellungsprozess, Yelp-Fallstudie, Strategien zur internen Verlinkung. - Backlinko — Programmatisches SEO: Der ultimative Leitfaden

backlinko.com/programmatic-seo

Wichtige Daten: Zillow (243 Mio. Besuche), Wise (10 Mio.+ Seiten), Zapier (590.000 Seiten), TripAdvisor (100.000+ Keywords). - AirOps — Versteckte Gefahren des programmatischen SEO

airops.com/blog/hidden-dangers-of-programmatic-seo

Wichtige Daten: Muellers „schickes Banner für Spam"-Zitat, 8 Mio. entdeckte / 650.000 gecrawlte Seiten-Audit, ZoomInfo-Boom-Bust-Zyklus. - Seomatic — Best Practices für programmatisches SEO

seomatic.ai/blog/programmatic-seo-best-practices

Wichtige Daten: Schema-Markup-Anforderungen, Architektur interner Verlinkung, Schwellenwerte für Content-Einzigartigkeit. - Practical Programmatic — Zapier-Fallstudie

practicalprogrammatic.com/examples/zapier

Wichtige Daten: 590.000+ programmatische Seiten, 610.000+ monatliche organische Besuche aus dem /apps/-Unterordner. - Kensaku AI — Nomadlist-Template-Analyse

kensakuai.com/template/nomadlist

Wichtige Daten: 2.000+ indexierte Stadtseiten, 50.000 monatlicher organischer Traffic, Echtzeitdaten pro Stadt. - Google Search Central — Core-Update März 2024 & Spam-Richtlinien

developers.google.com/search/blog/2024/03/core-update-spam-policies

Wichtige Daten: Richtlinie gegen skalierten Content-Missbrauch, 45-Tage-Rollout, Integration des Helpful-Content-Systems in den Core-Algorithmus. - Gupta Deepak — Das Paradoxon des programmatischen SEO

guptadeepak.com/the-programmatic-seo-paradox

Wichtige Daten: Wert-Schwellenwert-Framework (3 Tests), 85%-Test, 94% Traffic-Verlust über Nacht, 40% Content-Einzigartigkeits-Schwelle. - Valve and Meter — Einzugsgebiet-Seiten für Klempner

valveandmeter.com/blog/marketing/plumbing/service-area-pages-for-plumbers/

Wichtige Daten: Standortseiten erfüllen drei Zwecke — lokales Such-Targeting, Nähe-Signale, Domain-Autoritäts-Aufbau. - BrightLocal — Leitfaden für Einzugsgebiet-Seiten

brightlocal.com/learn/service-area-pages/

Wichtige Daten: Best Practices für standortspezifische Service-Seiten, Anforderungen an einzigartigen Content pro Standort. - Conbase — Googles Richtlinie gegen skalierten Content-Missbrauch verstehen

conbase.ai/seo/understanding-googles-scaled-content-abuse-policy

Wichtige Daten: 45 % Reduktion unorigineller Inhalte, Richtlinie gilt unabhängig von der Erstellungsmethode. - Whalesync — Anwendungsfall programmatisches SEO

whalesync.com/use-case/programmatic-seo

Wichtige Daten: Airtable + Webflow + Whalesync-Stack, von Y Combinator unterstützt, Zwei-Wege-Sync-Funktionen. - SearchAtlas — SEO-Statistiken 2026

searchatlas.com/blog/seo-statistics/

Wichtige Daten: SEO-Leads schließen mit 14,6 % ab vs. 1,7 % bei Outbound — 8,5x höhere Wahrscheinlichkeit der Conversion.